Temps de lecture : 3 Minutes

Composants, types et cas d’utilisation du pipeline de données

I write about fintech, data, and everything around it

Les données sont essentielles pour aider les organisations à élaborer de meilleures stratégies et à prendre des décisions éclairées sur le marché moderne d’aujourd’hui. Il permet aux entreprises d’être stratégiques dans leurs démarches, d’étayer leurs arguments, de trouver des solutions aux problèmes du quotidien et de mesurer l’efficacité d’une stratégie donnée.

En plus de ses avantages, la gestion et l’accès aux données est une tâche critique avec de nombreuses entreprises. Et c’est là que Data Pipeline s’avère le plus utile.

Data Pipeline permet aux data scientists et aux équipes d’accéder à des données basées sur des plateformes Cloud. Les outils de pipeline de données contrôlent les données d’un point de départ à un point de terminaison spécifié. Il vous permet de collecter des données à partir de nombreuses sources pour créer des informations utiles pour un avantage concurrentiel.

Même les spécialistes des données les plus expérimentés peuvent rapidement être dépassés par le volume, la vitesse et la diversité des données. Pour cette raison, les organisations utilisent un pipeline de données pour transformer les données brutes en informations analytiques de haute qualité.

Pour approfondir votre compréhension du pipeline de données, nous avons élaboré ce guide définitif qui couvre ses composants, ses types, ses cas d’utilisation et tout.

Alors ce guide est pour vous. Plongeons dedans.

Qu’est-ce qu’un pipeline de données ?

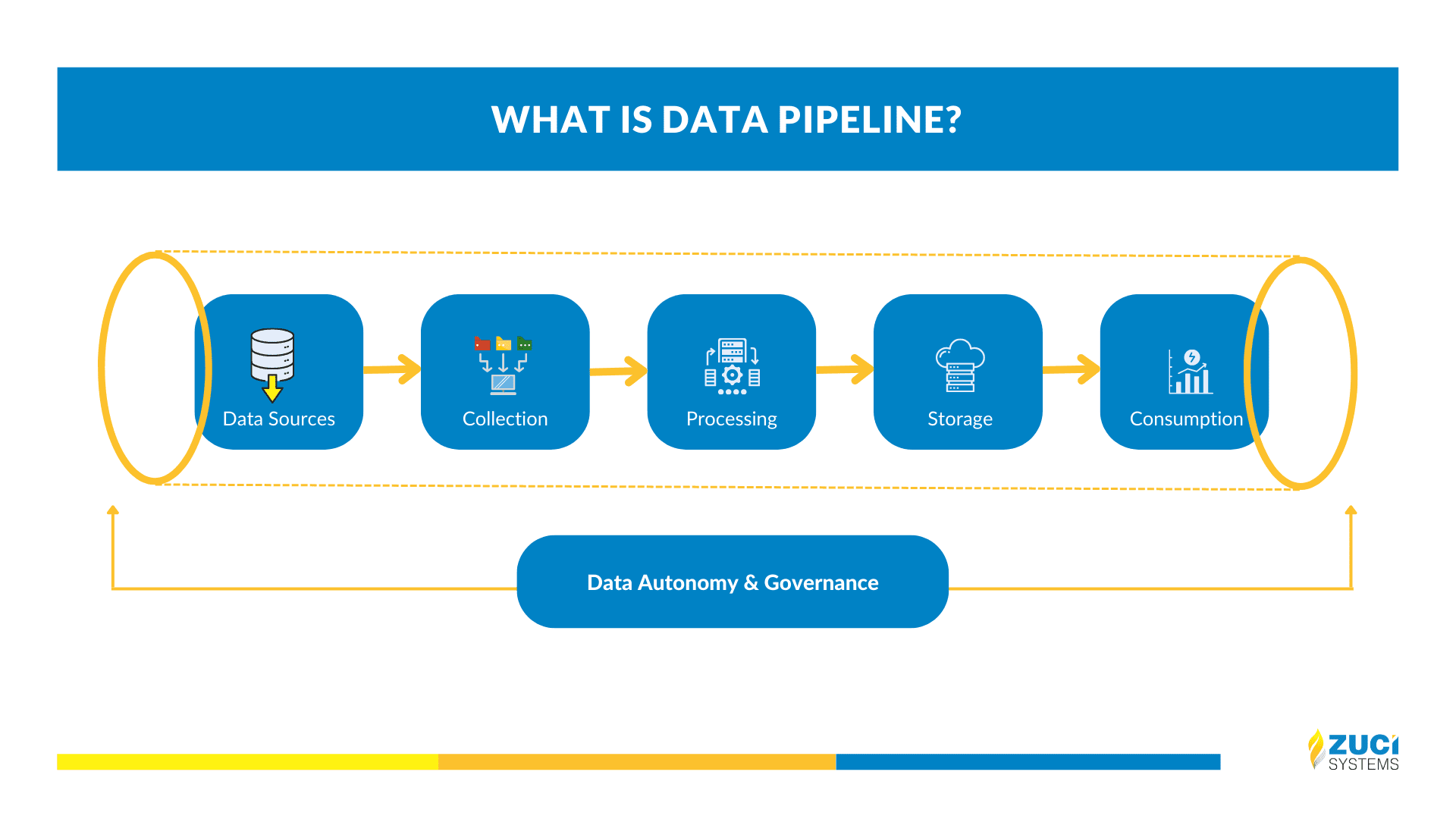

Un pipeline de données est un ensemble d’outils, d’actions et d’activités mis en œuvre dans un ordre spécifique pour collecter des données brutes à partir de plusieurs sources et les déplacer vers une destination pour le stockage et l’analyse. Un pipeline de données lui permet de collecter automatiquement des données à partir de plusieurs sources, de les modifier et de les combiner en un seul stockage de données hautes performances.

Les cinq composants critiques d’un pipeline de données sont le prétraitement, le stockage, l’analyse, les applications et la livraison. Ces cinq composants aident les organisations à travailler de manière transparente avec les données et à générer des informations précieuses.

Pourquoi devriez-vous implémenter un pipeline de données ?

Un pipeline de données vous aide à comprendre le Big Data et à le transformer en informations de haute qualité pour l’analyse et l’informatique décisionnelle. Quelle que soit leur taille, toutes les entreprises peuvent utiliser des pipelines de données pour rester compétitives sur le marché actuel. Ces données peuvent être utilisées pour comprendre les besoins des clients, vendre des biens et générer des revenus. Puisqu’elle offre cinq éléments essentiels, l’intégration du pipeline de données joue un rôle important dans le processus et permet aux entreprises de gérer d’énormes quantités de données.

Les données se développent rapidement et continueront de se développer. Et en l’occurrence, les pipelines de données aideront à transformer toutes les données brutes en un flux de données quotidien. Les applications, l’analyse de données et l’apprentissage automatique peuvent tous utiliser ces données modifiées. Si vous avez l’intention d’utiliser ces données, vous aurez besoin d’une intégration de données, qui nécessite un pipeline de données.

Pipeline de données contre ETL

Les expressions ETL et Data Pipeline sont parfois utilisées de manière interchangeable, mais elles diffèrent légèrement. ETL fait référence à l’extraction, la transformation et le chargement. Les pipelines ETL sont largement utilisés pour extraire des données d’un système source, les convertir en fonction des exigences et les charger dans une base de données ou un entrepôt de données principalement à des fins analytiques.

- Extrait: Acquisition et ingestion de données à partir de systèmes sources originaux et divers.

- Transformer: Transférer des données dans une zone de transit pour un stockage à court terme et transformer les données afin qu’elles soient conformes aux formulaires acceptés pour d’autres applications, telles que l’analyse.

- Charger: Chargement et transfert de données reformatées sur le lecteur cible.

Le pipeline de données, en revanche, peut être considéré comme une expression plus générale qui inclut ETL en tant que sous-ensemble. Il fait allusion à un système utilisé pour transférer des données entre les systèmes. Il peut y avoir ou non des modifications apportées à ces données. Selon les besoins de l’entreprise et des données, il peut être traité par lots ou en temps réel. Ces informations peuvent être placées à différents endroits, tels qu’un panier AWS S3 ou un lac de données.

Il peut même activer un Webhook sur un autre système pour lancer une activité commerciale particulière.

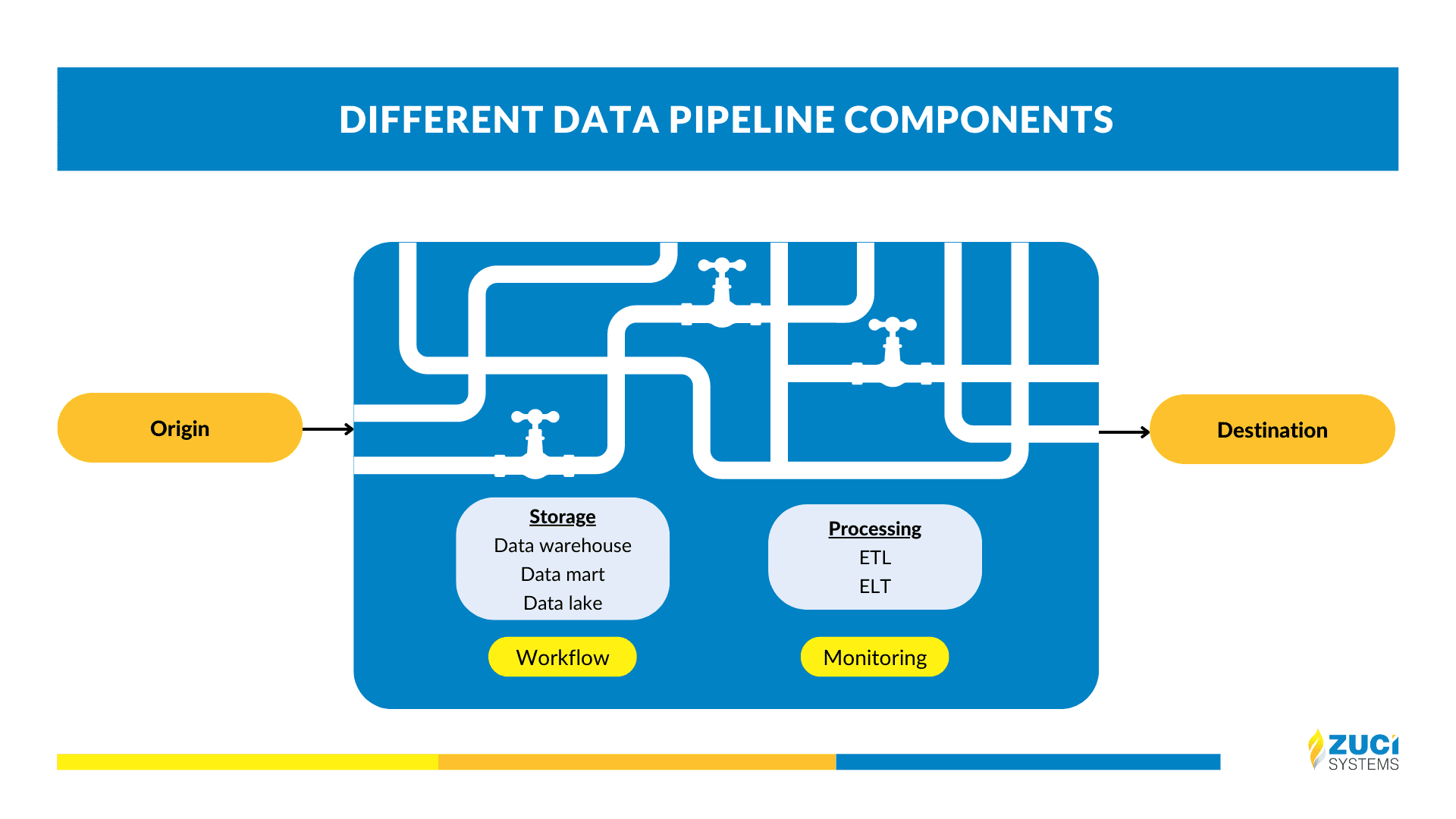

Différents composants de pipeline de données

Un pipeline de données se compose de divers composants. Tous ces composants de pipeline de données ont leurs exigences techniques et leurs défis à surmonter. Vous devez d’abord connaître les composants d’un pipeline de données pour comprendre son fonctionnement. La structure typique d’un pipeline de données ressemble à ceci :

1. Origine

Dans un pipeline de données, l’origine est l’endroit où les données sont saisies pour la première fois. Il est souvent piloté par la conception du magasin de données. La plupart des pipelines proviennent de systèmes de stockage tels que des entrepôts de données, des lacs de données, des applications de traitement transactionnel, des médias sociaux, des API et des capteurs d’appareils IoT.

L’endroit idéal pour les données devrait généralement être là où il est le plus logique de réduire la latence pour les pipelines en temps quasi réel ou d’optimiser les performances transactionnelles Si les systèmes transactionnels fournissent des informations fiables et opportunes requises à la destination du pipeline, ils doivent être considérés comme une ou des origine(s).

2. Destination

Une destination est un point de terminaison vers lequel les données sont finalement transportées. Le point de terminaison peut être n’importe quoi, d’un entrepôt de données à un lac de données. Cela dépend surtout du cas d’utilisation. C’est l’objectif de tout le processus. Lors de la création de vos pipelines de données, vous devez commencer ici.

La détermination de l’origine et de la destination va de pair, les besoins des terminaux affectant la découverte des sources de données et la sélection des sources de données influençant le choix des terminaux du pipeline. Par exemple, il est nécessaire de prendre en compte à la fois les exigences de rapidité à la destination du pipeline et les restrictions de latence à l’origine du pipeline.

3. Flux de données

L’origine et la destination déterminent ensemble ce qui entre dans le pipeline et ce qui en sort, tandis que le flux de données est ce qui spécifie comment les données se déplacent dans un pipeline. En termes simples, le flux de données est l’ordre dans lequel les processus et les magasins sont utilisés pour transporter les données d’une source à un point de terminaison. Il fait référence au transfert de données entre les points d’origine et de destination ainsi que les modifications qui y sont apportées. Les trois phases du flux de données sont :

- Extrait: Il est défini comme le processus d’extraction de toutes les données essentielles de la source. Pour la plupart, les sources incluent des bases de données telles que MySQL, Oracle, MongoDB, CRM, ERP, etc.

- Transformer:C’est le processus de transformation des données essentielles en un format et une structure adaptés à l’analyse. Cela se fait avec une meilleure compréhension des données à l’aide d’outils d’intelligence d’affaires ou d’analyse de données. Il comprend également des activités telles que le filtrage, le nettoyage, la validation, la déduplication et l’authentification.

- Charger: C’est le processus de stockage des données converties à l’emplacement souhaité. Le chargement est un terme fréquemment utilisé pour décrire les entrepôts de données comme Amazon Redshift, Google BigQuery, Snowflake et autres.

4. Stockage

Le stockage fait référence à tous les systèmes utilisés pour conserver les données au fur et à mesure qu’elles traversent les différentes étapes du pipeline de données. Les facteurs qui influencent les options de stockage disponibles sont le volume de données, la fréquence et la profondeur de recherche d’un système de stockage et la manière dont les données seront utilisées.

5. Traitement

Le traitement fait référence aux étapes et aux activités suivies pour collecter, transformer et distribuer les données dans le pipeline. Le traitement des données, tout en étant connecté au flux de données, se concentre sur l’exécution de ce mouvement. Le traitement convertit les données d’entrée en données de sortie en effectuant les étapes appropriées dans le bon ordre. Ces données sont exportées ou extraites pendant le processus d’ingestion et encore améliorées, améliorées et formatées pour l’utilisation prévue.

6. Flux de travail

Le flux de travail décrit l’ordre des activités ou des tâches dans un pipeline de données et leur interdépendance. Vous bénéficierez grandement ici si vous connaissez les emplois, en amont et en aval. Les emplois font référence aux unités discrètes de travail qui terminent une certaine tâche, dans ce cas, la modification des données. L’amont et l’aval font référence aux sources et aux destinations des données transitant par un pipeline.

7. Surveillance

L’objectif principal de la surveillance est d’examiner l’efficacité, l’exactitude et la cohérence des données à mesure qu’elles traversent les différentes étapes de traitement du pipeline de données et de s’assurer qu’aucune information n’est perdue en cours de route. Il est fait pour s’assurer que le Pipeline et toutes ses étapes fonctionnent correctement et effectuent les tâches nécessaires.

Regardez cette vidéo de notre responsable technique – Business Intelligence, Balasubramanian Loganathan, pour découvrir 8 étapes importantes pour créer un pipeline de données optimal.

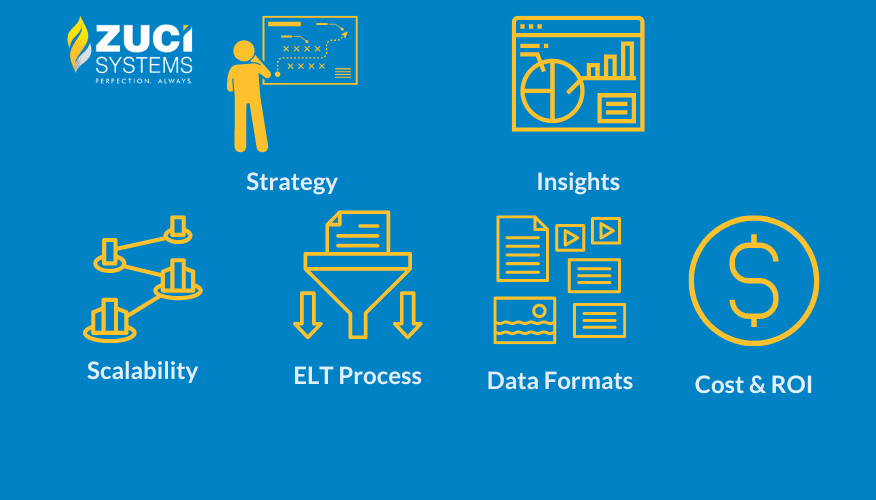

Architecture de pipeline de données

Les entreprises s’orientent vers la mise en œuvre d’outils de pointe, d’une infrastructure cloud native et de technologies pour améliorer leurs opérations commerciales. Cela nécessite de transférer d’énormes quantités de données. Les pipelines de données automatisés sont des éléments essentiels de cette pile contemporaine qui permettent aux entreprises d’enrichir leurs données, de les collecter en un seul endroit, de les analyser et d’améliorer leur intelligence économique. Cette pile moderne comprend :

- Un outil de pipeline de données automatisé

- Une plateforme Cloud de destination telle que Databricks, Amazon Redshift, Snowflake, Data Lakes, Google BigQuery, etc.

- Outils de Business Intelligence tels que Tableau, Looker et Power BI

- Un outil de transformation de données

L’ingestion de données, la transformation et le stockage sont les trois phases principales de l’architecture du pipeline de données.

1. Ingestion de données

Pour collecter des données (données structurées et non structurées), plusieurs sources de données sont utilisées. Les producteurs, les éditeurs et les expéditeurs sont des termes couramment utilisés pour décrire les sources de données en continu. Avant de collecter et de traiter des données brutes, il est toujours préférable de s’entraîner à les stocker dans un entrepôt de données cloud. Les entreprises peuvent également mettre à jour les anciens enregistrements de données en utilisant cette technique pour modifier les tâches de traitement des données.

2. Transformation des données

À cette étape, les données sont traitées dans le format requis par le référentiel de données final via une série de tâches. Ces activités garantissent que les données sont régulièrement nettoyées et transformées en automatisant les flux de travail répétitifs, tels que les rapports d’activité. Dans le cas d’un flux de données au format JSON imbriqué, par exemple, des champs clés peuvent être récupérés lors de l’étape de transformation des données à partir de flux JSON imbriqués.

3. Stockage des données

Après stockage, les données modifiées sont rendues accessibles aux différentes parties prenantes au sein d’un référentiel de données. Dans les données de diffusion en continu, les données transformées sont fréquemment appelées clients, abonnés ou récepteurs.

Types d’architecture de pipeline de données

Pour créer un pipeline de données efficace, vous devez d’abord connaître ses architectures. Il existe différentes architectures de pipeline de données qui offrent différents avantages. Et nous examinerons chacun d’eux plus en détail ci-dessous :

Pipeline de données ETL

Le terme “pipeline ETL” fait référence à une série d’opérations qui sont effectuées pour transférer des données d’une ou plusieurs sources vers une base de données cible, généralement un entrepôt de données. Les trois étapes de l’intégration des données, “extraire, transformer et charger” (ETL), sont entrelacées et permettent le transfert de données d’une base de données à une autre. Une fois les données importées, elles peuvent être analysées, rapportées et utilisées pour éclairer les décisions commerciales stratégiques.

Cas d’utilisation :

- Faciliter le transfert d’informations d’un ancien système vers un système de stockage de données moderne.

- En collectant toutes les données en un seul endroit, de nouvelles informations peuvent être obtenues.

- Compléter les informations stockées dans un système avec des informations stockées dans un autre.

Pipeline de données ELT

ELT (Extraire, charger et transformer) décrit les étapes utilisées par un pipeline de données pour dupliquer le contenu du système source vers un système de destination, comme un entrepôt de données cloud.

Cas d’utilisation :

- Faciliter le reporting à la volée

- Faciliter l’examen des données en temps réel

- Activation d’un logiciel supplémentaire pour effectuer des procédures d’entreprise supplémentaires

Pipeline de données par lots pour l’analyse traditionnelle

Les organisations utilisent des pipelines de données par lots lorsqu’elles doivent régulièrement déplacer une grande quantité de données. Pour la majorité, le pipeline de données par lots est exécuté selon un calendrier prédéterminé. Par exemple, il est utilisé lorsque les données doivent être traitées toutes les 24 heures ou lorsque le volume de données atteint un seuil prédéterminé.

Cas d’utilisation :

- Construire un entrepôt de données pour l’analyse et le reporting mensuels

- Intégration des données sur deux plateformes ou plus

Comment rationaliser l’étiquetage des données pour l’apprentissage automatique : outils et approches pratiques que vous devez connaître

Il s’agit d’un guide concis pour vous aider à résoudre le problème de la douleur liée à l’étiquetage des données. Il présente plusieurs outils et approches pratiques que vous devez connaître pour rationaliser votre processus.

Stream-based Pipeline

L’analyse en temps réel ou en continu consiste à tirer des conclusions à partir de flux de données rapides en quelques millisecondes. Contrairement au traitement par lots, un pipeline de streaming met à jour en continu les métriques, les rapports et les statistiques récapitulatives en réponse à chaque événement qui devient disponible. Il ingère également en continu une série de données au fur et à mesure de leur génération.

Cas d’utilisation :

- Surveillance de l’infrastructure informatique et rapports

- Dépannage des logiciels, du matériel et plus encore grâce à la surveillance des journaux

- La gestion des informations sur les événements et la sécurité (SIEM) consiste à surveiller, mesurer et détecter les menaces en analysant les journaux et les données d’événements en temps réel.

- Stock de détail et d’entrepôt : gestion du stock dans tous les magasins et entrepôts et facilité pour les clients d’accéder à leurs commandes depuis n’importe quel appareil

- Associer des trajets avec les conducteurs les plus appropriés en termes de distance, d’emplacement, de prix et de longues attentes nécessite d’intégrer des données sur les emplacements, les utilisateurs et les tarifs dans des modèles analytiques.

Gazoduc Lambda

Ce pipeline combine un pipeline batch avec un pipeline de streaming. Parce qu’elle permet aux programmeurs de prendre en compte à la fois les cas d’utilisation du streaming en temps réel et l’analyse par lots historiques, cette architecture est fréquemment utilisée dans les contextes Big Data. Le fait que cette conception favorise la conservation des données dans leur forme brute signifie que les développeurs peuvent exécuter de nouveaux pipelines pour résoudre tout problème avec des pipelines plus anciens ou incorporer des destinations de données supplémentaires en fonction du cas d’utilisation.

Cas d’utilisation :

- Conversion rapide

- Les utilisateurs n’ont pas toujours besoin de spécifications, de manuels ou de données de transaction dans un format standard. La création de documents à la demande est généralement plus simple. Le logiciel Lambda peut rapidement et facilement récupérer, formater et transformer du contenu pour le mettre en ligne ou le télécharger.

- Sauvegardes et tâches quotidiennes

- Les événements Lambda programmés sont fantastiques pour effectuer la maintenance des comptes AWS. Grâce à Lambda, il est possible de créer rapidement des activités courantes telles que la création de sauvegardes, la surveillance des ressources inactives et la génération de rapports.

Pipeline Big Data pour l’analyse de Big Data

Les développeurs et les concepteurs ont dû s’adapter à la diversité, au volume et à la vitesse croissants du Big Data. Big Data signifie un grand volume. Cette grande quantité d’informations peut permettre le reporting d’investigation, la surveillance et l’analyse des données.

Les Big Data Pipelines peuvent transformer de gros volumes de données, contrairement aux Data Pipelines classiques. Les Big Data Pipelines traitent les informations dans des flux et des groupes. Quelle que soit la méthode, un Big Data Pipeline doit être évolutif pour répondre aux besoins de l’entreprise.

Cas d’utilisation :

- Les entreprises de construction tiennent des registres méticuleux de tout, des heures de travail aux dépenses en matériaux.

- Des magasins, physiques et virtuels, qui surveillent les préférences des consommateurs.

- Le Big Data est utilisé par les secteurs bancaire et financier pour prévoir les tendances des données et améliorer la qualité du service client.

- Les systèmes de santé passent au crible des montagnes de données, à la recherche de thérapies nouvelles et améliorées.

- Les entreprises opérant dans les secteurs social, du divertissement et des communications utilisent le Big Data de plusieurs manières, telles que la fourniture de mises à jour en temps réel des médias sociaux, la facilitation des connexions entre les smartphones et l’amélioration du streaming multimédia HD.

Avantages et inconvénients de l’architecture du pipeline de données

| Exemples d’architecture de pipeline de données | Avantages | Désavantages |

| Pipeline de données ETL |

|

|

| Pipeline de données ELT |

|

|

| Pipeline de données par lots |

|

|

| Stream-based Pipeline |

|

|

| Gazoduc Lambda |

|

|

| Pipeline de données volumineuses |

|

|

Exemples de pipeline de données

C’est une chose pour vous de collecter des données, mais c’en est une autre si vous n’êtes pas en mesure de les comprendre et de les analyser d’une manière avantageuse pour l’entreprise. Le pipeline de données contemporain est utile dans cette situation. Mettre à l’échelle vos données et en tirer des conclusions sont des compétences essentielles pour toute organisation, petite ou grande. La capacité à gérer et à déployer des pipelines évolutifs vous permettra de découvrir des informations que vous n’auriez jamais imaginées possibles et vous aidera à réaliser le plein potentiel de vos données.

L’infrastructure des systèmes numériques est constituée de pipelines de données. Les pipelines transportent les données, les traitent et les stockent afin que les entreprises puissent obtenir des informations utiles. Cependant, les pipelines de données doivent être mis à jour afin de pouvoir gérer la complexité et le volume croissants de données. Cependant, les équipes pourront prendre de meilleures décisions plus rapidement et acquérir un avantage concurrentiel à l’aide de pipelines de données modernes et efficaces une fois le processus de modernisation terminé.

Liste des entreprises utilisant Data pipeline :

Uber

Uber a commencé à travailler sur son pipeline de données, Michelangelo, en 2015. Il a permis aux équipes internes de l’entreprise de créer, mettre en œuvre et gérer des solutions d’apprentissage automatique. Il a été créé pour pouvoir gérer les phases de gestion des données, de formation, d’évaluation et de déploiement du flux de travail d’apprentissage automatique. À l’aide de ces informations, il peut également prévoir les événements futurs et les suivre.

Avant le développement de Michelangelo, Uber avait du mal à développer et à déployer des modèles d’apprentissage automatique à la portée et à l’échelle de son entreprise. Cela a limité l’utilisation de l’apprentissage automatique par Uber à ce qu’un petit nombre de data scientists et d’ingénieurs talentueux pouvaient créer en un temps limité. Cette plate-forme supervise non seulement Uber Eats, mais également des centaines d’autres modèles comparables avec des cas d’utilisation prédictifs utilisés par l’ensemble de l’organisation.

Michelangelo discute des estimations de délais de livraison de nourriture, des classements de restaurants, des classements de recherche et de la saisie semi-automatique de recherche en utilisant UberEATs comme exemple. Avant de passer une commande et à chaque étape du processus de livraison, ce modèle de livraison informe le client du temps qu’il faudra pour préparer et livrer un repas. Les scientifiques des données d’Uber Eats utilisent des modèles de régression d’arbre de décision à gradient boosté pour prévoir ce délai de livraison de bout en bout sur Michelangelo. Cette prévision a été faite en utilisant les informations sur l’heure de la journée, le temps moyen de préparation des repas au cours de la semaine précédente et le temps moyen de préparation des repas au cours de l’heure précédente.

GoFundMe

GoFundMe est la plus grande entreprise de collecte de fonds sociaux au monde, ayant amassé plus de 25 millions de donateurs et plus de 3 milliards de dollars de dons. Malgré cela, il lui manquait un entrepôt central pour contenir les informations de ses bases de données relationnelles sur le backend, les événements et analyses en ligne, le service d’assistance et d’autres sources, qui totalisaient environ un milliard d’occurrences chaque mois. Sans cette centralisation, ces métriques étaient cloisonnées et leur personnel informatique était incapable d’avoir une compréhension approfondie de la direction que prenait leur entreprise.

Pour atteindre cet objectif, GoFundMe était conscient qu’il avait besoin d’un flux de données flexible et adaptatif. Au final, leur pipeline leur a fourni tous les connecteurs dont ils ont besoin pour leurs sources de données, ainsi que la flexibilité de créer des scripts Python uniques qui leur permettraient de modifier leurs données selon leurs besoins, leur donnant un contrôle total. Ce pipeline a fourni à GoFundMe flexibilité et intégrité, car il avait mis en place des mesures pour empêcher l’utilisation de scripts ETL personnalisés, susceptibles de modifier les données. Pour éviter que les données ne soient perdues, endommagées ou dupliquées à l’intérieur du pipeline, une fonctionnalité est la possibilité de les rediffuser.

AT&T

Des millions de personnes, des gouvernements fédéraux, étatiques et locaux, de grandes entreprises et d’autres organisations comptent sur AT&T comme principal fournisseur de services de communication et de télévision. Ils s’appuient en grande partie sur un flux de données fluide pour offrir ces services. De plus, ils hébergent les centres de données de plusieurs clients, offrent des services cloud et assistent avec les solutions IVR. AT&T a dû conserver ces enregistrements plus longtemps en raison d’une modification de la règle de vente par télémarketing de la Federal Trade Commission, qui les obligeait à reconsidérer leurs technologies de transfert de données.

Étant donné qu’AT&T sous-traite la majorité des services fournis par ses centres d’appels à des sous-traitants externes, il était difficile de déplacer ce matériel en toute sécurité de 17 centres d’appels vers leurs centres de données. Ils avaient besoin d’un mouvement de données fiable et d’un transfert de fichiers rapide pour transmettre ces enregistrements audio. En fin de compte, AT&T avait besoin d’un pipeline avec une vitesse et une capacité de transmission accrues ainsi qu’une facilité d’installation, d’automatisation et de planification.

Le mandat de la Federal Trade Commission était assuré par le nouveau pipeline d’AT&T, qui simplifiait le transport de dizaines de milliers d’énormes fichiers audio par jour. Des rapports détaillés, une sécurité de pointe, une pléthore de choix de configuration et des workflows configurables sont également inclus.

Implémentation des pipelines de données

Votre pipeline de données peut être construit sur site ou mis en œuvre à l’aide des services cloud de fournisseurs.

Pipeline de données open source

Vous pouvez utiliser des alternatives open source si votre entreprise considère que les solutions de pipeline commerciales sont d’un coût prohibitif.

Avantages

- Le prix du logiciel d’analyse de données

- Le téléchargement, l’étude et l’utilisation de logiciels open source sont entièrement gratuits. Ainsi, les analystes commerciaux et les ingénieurs peuvent expérimenter rapidement et à moindre coût une variété de solutions open source pour voir ce qui fonctionne le mieux.

- Personnalisation illimitée

- Les programmes open source peuvent être difficiles à utiliser, mais vous pouvez modifier le code.

- Les outils open source sont flexibles pour le traitement des données.

Désavantages:

- Pas de support commercial

- La communauté Open-large source est excellente, mais vous avez parfois besoin d’une solution rapide provenant d’une source fiable.

- Selon leur popularité et leur influence, certaines technologies open source sont obsolètes, à peine entretenues ou anciennes. Peut-être que ceux qui ont surveillé la base de code et vérifié les ajouts de code communautaire sont devenus trop occupés ou ont trouvé un nouvel emploi.

Cas d’utilisation :

- Tirez parti des technologies de pipeline de données open source tout en conservant les mêmes cas d’utilisation pour le traitement par lots et en temps réel

Pipeline de données sur site

Pour disposer d’un pipeline de données sur site, vous devez acheter et configurer des logiciels et du matériel pour votre centre de données personnel. De plus, vous devez vous occuper vous-même de l’entretien du centre de données, gérer la sauvegarde et la récupération des données, évaluer l’état de votre pipeline de données et étendre la puissance de stockage et de traitement. Même si cela prend beaucoup de temps et de ressources, cette méthode vous fournira un contrôle total sur vos données.

Avantages

- Ne formez de nouveaux clusters et n’allouez des ressources qu’en cas d’absolue nécessité.

- L’option de restreindre les tâches à des moments précis de la journée.

- Sécurité des informations stockées et transmises. Le mécanisme de contrôle d’accès dans AWS permet de réguler précisément qui a accès à quelles ressources.

Désavantages

- Préparation qui prend beaucoup de temps

- Défis liés à la compatibilité

- Dépenses engagées pour l’entretien

Cas d’utilisation :

- Partager des informations sur les ventes et le marketing avec les systèmes de gestion de la relation client pour améliorer le service client.

- Transférer des informations sur l’utilisation en ligne et sur les appareils mobiles des consommateurs vers des plateformes de recommandation

Derniers plats à emporter

Vous avez maintenant une bonne compréhension du pipeline de données et de ses composants qui composent les pipelines modernes. Dans le marché actuel, toutes les entreprises doivent gérer un volume de données massif. Pour créer un pipeline de données à partir de zéro, vous devrez embaucher beaucoup de ressources et investir beaucoup de temps. Ce n’est pas seulement coûteux, mais cela prend aussi beaucoup de temps. Si vous souhaitez utiliser vos données et créer un pipeline de données efficace, vous pouvez utiliser les solutions Zuci basées sur le cloud. Cela réduira vos coûts d’exploitation, apportera de l’efficacité à vos opérations de données et vous fera gagner du temps.

Nous espérons que cet article vous plaira et que vous apprendrez comment l’étiquetage des données fait partie intégrante de la science des données ! Réservez un appel découverte pour notre prestations d’ingénierie des données aujourd’hui et devancez la concurrence. Rendez-le simple et rendez-le rapide.

Articles connexes